Чому ChatGPT чи інша модель ШІ вам не лікар?

15 січня 2026

💡Люди все частіше сприймають ChatGPT не просто як інструмент для виконання завдань або створення текстів, а як порадника і джерело інформації. Більшість запитів стосується повсякденних ситуацій, навчання й особистих потреб, а не професійної діяльності.

ℹ️80% людей хоча б раз гуглили свої симптоми замість звернутись до лікаря.

Однак постає питання: чи варто довіряти штучному інтелекту роль «особистого лікаря», який нібито доступний у будь-який час і знає відповіді на все?

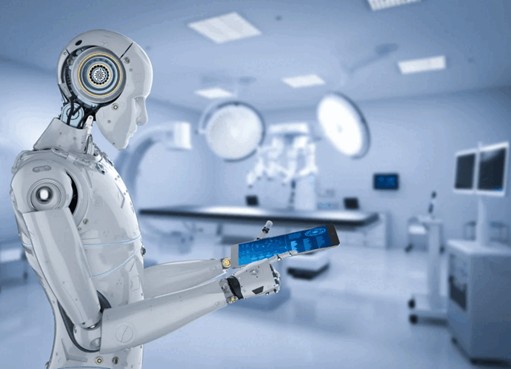

Штучний інтелект активно використовується в медицині, підвищуючи точність діагностики та ефективність лікування. Його застосовують для аналізу МРТ, КТ та рентгенівських знімків, що особливо важливо для раннього виявлення онкології, пневмонії та туберкульозу. Крім того, ШІ допомагає персоналізувати лікування, обробляючи геномні дані та історію хвороби пацієнта для підбору оптимальних терапевтичних стратегій.

Водночас керує процесом лікар — фахівець із медичною освітою та клінічним досвідом.

Лікар бачить перед собою не просто симптоми, а живу людину з її унікальною історією — хронічними хворобами, способом життя та емоційним станом. Алгоритм не може врахувати нюанси: як ви поводитеся під час розмови, зміни у голосі чи приховані за словами «мені просто трохи погано» сигнали.

👨⚕️Саме ці деталі часто допомагають лікарю визначити справжню причину проблем зі здоров’ям.

Є ще один важливий аспект — відповідальність: у разі помилки виправити ситуацію може лише фахівець, а не програма. Навіть найсучасніші алгоритми можуть помилятися, особливо в складних випадках або при нестачі даних. ШІ не здатен пояснити пацієнтові вибір методу лікування, підтримати людину у стресовій ситуації або дати пораду з урахуванням її життєвих обставин.

На сьогодні спеціального закону, що визначав би права, обов’язки та відповідальність лікарів при використанні штучного інтелекту в медицині, не існує. Проте неправильно вважати, що лікар не несе жодної відповідальності за застосування висновків ШІ у своїй практиці.

☝️Лікар зобов’язаний перевіряти та критично оцінювати рекомендації ШІ перед їх використанням для постановки діагнозу або призначення лікування. Фактично лікар є остаточним приймачем рішення. Якщо ШІ помилився, а лікар застосував неправильний діагноз чи рекомендацію і завдав шкоди пацієнту, відповідальність несе саме лікар, а не розробники ШІ.

Ключовим фактором успішного використання ШІ в медицині є дотримання лікарської таємниці та захист персональних даних пацієнтів. В Україні діють суворі правила конфіденційності: будь-яка обробка медичних даних повинна відповідати Закону про захист персональних даних і принципу лікарської таємниці. Передача інформації пацієнта в AI-систему можлива лише за наявності правових підстав (згоди пацієнта або спеціальної норми закону) і за умов гарантій безпеки.

Уявіть, людина відчуває легкий біль або дискомфорт і одразу шукає симптоми в Google: «біль унизу живота», «нудота після їди», «як лікувати головний біль вдома». Результати з’являються миттєво — статті, форуми, відео, поради від різних людей. Інформація може бути суперечливою: від авторитетних медичних джерел до блогів людей без медичної освіти.

Величезний обсяг інформації, доступний за секунди, може дезорієнтувати та налякати. Пацієнт ризикує отримати сумнівну пораду або поставити собі неправильний діагноз. Через «самодіагностику» зросла кількість звернень до лікарів: люди часто впевнені у рідкісних хворобах, тоді як аналіз спеціаліста показує щось значно простіше.

З появою ChatGPT та інших сучасних мовних моделей змінюється підхід: тепер користувач має не лише пошук, а «співрозмовника», який розуміє питання, дає структуровані відповіді та може надати покрокові рекомендації. Модель, що генерує відповіді на основі аналізу текстів, швидко створює ілюзію впевненості. Саме тому важливо розуміти, де корисність ШІ закінчується, а починається компетенція лікаря.

«ШІ створений, щоб замінити лікарів» — це міф. Мета впровадження штучного інтелекту полягає в тому, щоб розширити можливості медицини, а не замінити фахівців. Складні випадки й надалі вирішуватимуть професійні лікарі, тоді як ШІ виконуватиме допоміжні функції.

У сучасному цифровому світі важливо встановлювати чіткі межі та пам’ятати: справжній діалог між пацієнтом і лікарем унікальний. Це не лише обмін інформацією, а й емпатія, довіра та, врешті-решт, питання життя і здоров’я.

Тож, якщо щось болить, шукати симптоми в Google чи питати AI — це як шукати поради про шлюб у TikTok: цікаво, але не надто корисно.

Не лікуйтеся за порадою Штучного Інтелекту!